Voici donc venu le temps de la lutte des classes, mise en algorithme. Et c’est Facebook cette fois qui s’y colle. A tout seigneur, tout déshonneur.

Depuis le temps que je vous raconte que le projet des grandes plateformes de l’internet est avant tout un projet politique. Depuis le temps que je dénonce le risque d’un fascisme documentaire opposant une humanité sous-documentée à une humanité sur-documentée.

Et depuis le temps … Depuis le temps que le #DigitalLabor est une réalité sociale avant que d’être un mot-dièse. Depuis le temps qu’Antonio Casilli parmi d’autres, creuse avec acharnement le sillon de ces nouvelles formes d’exploitation, de ces nouvelles « colonialités« .

Depuis le temps … Depuis le temps du capitalisme cognitif de Yann Moulier-Boutang et du capitalisme linguistique de Frédéric Kaplan qui ne cessent de structurer la réflexion sur le rôle (politique) et la place (économique) des plateformes (encore récemment dans ce papier de Nature).

Depuis le temps que l’Uberisation de tout et la Start-Up Nation de n’importe quoi (et réciproquement) nous préparent une démocratie de clients.

Là on y est. Mais alors on y est bien bien bien

Voici venu le temps. Celui ou en l’espace de quelques jours c’est Amazon qui propose de poser à ses salariés un bracelet permettant de détecter les mouvements de leurs mains. Tripalium et aliénation sont dans un entrepôt, et toute forme d’humanité tombe à l’eau. Ne reste plus que des « masses », des forces de travail désincarnées, et l’agitation devant elles de la carotte de l’aliénation et du bâton de la concurrence robotique : prends ce bracelet, accepte cette déshumanisation ou le robot, ou les robots, prendront ta place. Et ne pas croire qu’il ne s’agit que des GAFAM.

Face à cela, la grande famille du libéralisme bas du front s’est trouvé un autre dada, faire accroire que nous pourrions revendre nos données personnelles aux GAFAM en nous enrichissant au passage. C’est bien connu, face au patronat les ouvriers se sont toujours enrichis dans le cercle vertueux consistant à spéculer sur leur force de travail et à la revendre. Mais comme cette caricature de l’histoire économique des deux derniers siècles semble hélas trouver un écho médiatique, je vous presse d’aller lire deux textes absolument magistraux sur le sujet, celui de Lionel Maurel et Laura Aufrère « Pour une protection sociale des données personnelles » et sa « synthèse » dans Libération : « Données personnelles : défendons des liens plutôt que des biens. »

Mais où veut-il donc en venir ?

J’y viens. Nous le sentions. Nous le pressentions. Elle était là. Tapie dans l’ombre. La revoilà. La lutte des classes. LA LUTTE DES CLASSES. Mais entre temps les plateformes, les algorithmes et les données, sont passés par là.

Voici donc venu le temps de la lutte des classes, mise en algorithme. Et c’est Facebook cette fois qui s’y colle. A tout seigneur, tout déshonneur.

La lutte des classes. Mais la lutte algorithmique déclasse

Le 1er Février 2018 Facebook a obtenu la publication d’un brevet qu’il avait déposé en Juillet 2016, brevet intitulé « Socioeconomic group classification based on user features ». (disponible en pdf et en intégralité par ici)

C’est un brevet permettant de prédire le « groupe socio-économique » d’un utilisateur. C’est à dire sa classe sociale. Pourquoi ? Pour le bien de l’humanité et des peuples opprimés. Nan je déconne. Pour permettre aux « tierces-parties » (c’est à dire aux annonceurs) d’améliorer leur ciblage publicitaire.

« By predicting the socio-economic groups of users, [Facebook] is able to help the third party present sponsored content to the target users.«

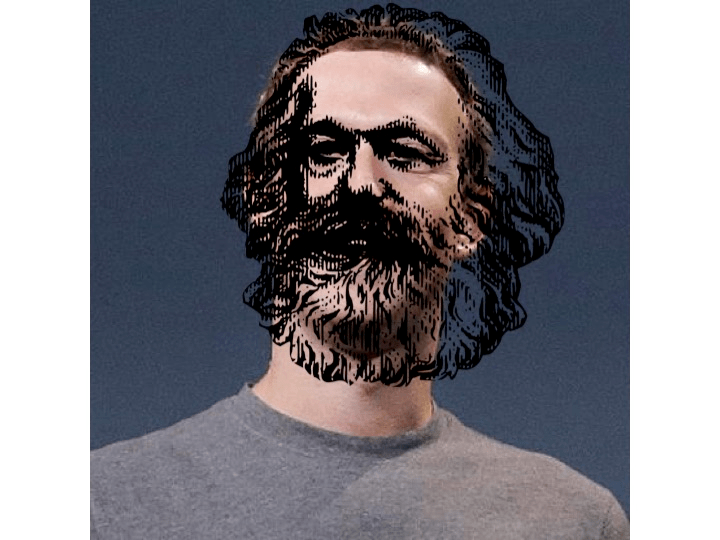

Karl Mar(x)k Zuckerberg

Pour Facebook et pour Mark (Zuckerberg) les classes sociales, c’est assez simple, il y en a trois. Working Class, Middle Class, Upper Class. Vous me direz, pour Karl (Marx) il n’y en avait que deux, le prolétariat et la bourgeoisie et c’est son copain Max( Weber) qui introduisit une classe moyenne / intermédiaire.

« La société bourgeoise moderne, élevée sur les ruines de la société féodale, n’a pas aboli les antagonismes de classes, elle n’a fait que substituer de nouvelles classes, de nouvelles conditions d’oppression à celles d’autrefois. Cependant, le caractère distinctif de notre époque est d’avoir simplifié les antagonismes de classes. La société entière se scinde en deux vastes camps ennemis en deux grandes classes qui s’affrontent directement : la bourgeoisie et le prolétariat. » Karl Marx. Manifeste du parti communiste.

« Simplifier les antagonismes de classe ». Voilà bien la logique, comme le faisait remarquer Antonio Casilli.

Le brevet de Facebook part d’un constat qui est une pure merveille de je ne sais pas trop quoi, mais en tout cas une pure merveille :

Je vous résume l’affaire. En gros, le meilleur moyen de déterminer le niveau de vie (« socio-economic group ») d’un utilisateur c’est de regarder son salaire (« income »). Mais les utilisateurs rechignent un peu à balancer sur Facebook leurs salaires parce que c’est de l’information « sensible ». Ils font chier. Du coup on perd du temps à afficher des pubs pour des Rolex à des prolétaires mal dégrossis. Et ça c’est pas bon pour le business. Bah non, ce qu’il faut c’est s’assurer que ceux qui ont les moyens d’investir le prix d’un Smic dans un téléphone voient toujours davantage de pubs de téléphone et toujours moins de Smicards. Et que ceux qui gagnent le SMIC arrêtent de voir des pubs pour des téléphones qu’il ne pourront jamais se payer. Salauds de pauvres.

Mais comme les pauvres ils sont chiants à venir rêver sur les marques de luxe des riches et que ça fait perdre de l’engagement et du reach pour les annonceurs et donc du budget et du cash pour la plateforme hôte, ben on va mettre un terme à tout ça en « prédisant » la classe sociale des gens puisqu’ils ne veulent pas nous filer leur salaire ou qu’ils seraient capables de nous mentir. « More engaging user experience based on predicted socioeconomic group« , voilà comment ça s’appelle.

Une pure merveille vous dis-je. Vous noterez d’ailleurs que tout au long de ce brevet on ne parle jamais « d’annonceurs » mais toujours de « tiers » (third-parties). On dirait presque du Molière. « Voiturez-nous ici les commodités de la conversation ».

Bref.

Pour Facebook toujours, l’appartenance à l’une ou l’autre de cette sainte trilogie se joue autour de différents facteurs dont : des données démographiques, le nombre de terminaux (« devices ») possédés, l’usage d’internet (= temps passé sur), l’historique de voyage (biais géographico-culturel américain : l’Upper Class américaine et une partie de la Middle Class se déplace pas mal en avion pour couvrir l’étendue du territoire américain, qu’il s’agisse de voyages « familiaux » ou de voyages d’affaire), les données domestiques (ou « familiales », traduction de « Household Data ») et, donc, le groupe socio-économique.

Dans la théorie de Marx, pour qu’une classe puisse exister il faut qu’elle ait conscience d’être une classe. Qu’elle soit capable de se reconnaître elle-même dans une distance réflexive qui lui permet alors de se mobiliser, d’entrer en action, en lutte et en résistance.

Alors bien sûr en découvrant ce brevet, certain(e)s d’entre vous se demanderont peut-être quel en est l’intérêt étant donné que nombre d’études attestent qu’il est déjà capable d’identifier notre niveau de vie et notre « classe socio-économique » au regard de la masse de données dont il dispose, et même lorsque nous tentons délibérément d’embrouiller l’algorithme avec de fausses données déclaratives (genre dire qu’on est homosexuel si on est hétérosexuel).

J’ai plusieurs hypothèses.

Simplifier les antagonismes de classe

La première c’est que la quantité (de données) ne fait pas forcément leur qualité. Et que la caractérisation fine d’un individu repose sur des données et des interactions qualifiées et plutôt de haut-niveau (par opposition aux interactions kakonomiques ou de bas niveau). Or notre usage de Facebook est de plus en plus un usage de défilement et de diffusion : on regarde ce qui tombe dans notre news feed et on le repartage (ou pas). En face de cette baisse des interactions qualifiées, Facebook est en permanence à la recherche de techniques permettant de « muscler » son algorithme pour mieux inférer et prédire des comportements ou des appartenances (sociales). Cette hypothèse ne pourra jamais bien sûr être vérifiée puisque seul Facebook dispose des données permettant d’attester de cette baisse des interactions de haut-niveau, et qu’il est assez peu probable, si elle est avérée, qu’il communique dessus ou qu’il l’admette simplement.

L’autre hypothèse est littéralement Marxiste dans le texte : plus d’un siècle et demi après le Manifeste du Parti Communiste, nous entrons dans une nouvelle phase de simplification et d’essentialisation.

« Cependant, le caractère distinctif de notre époque est d’avoir simplifié les antagonismes de classes. »

La suite du passage est d’ailleurs troublante :

« La bourgeoisie a joué dans l’histoire un rôle éminemment révolutionnaire. Partout où elle a conquis le pouvoir, elle a détruit les relations féodales, patriarcales et idylliques. Tous les liens variés qui unissent l’homme féodal à ses supérieurs naturels, elle les a brisés sans pitié pour ne laisser subsister d’autre lien, entre l’homme et l’homme, que le froid intérêt, les dures exigences du « paiement au comptant ». Elle a noyé les frissons sacrés de l’extase religieuse, de l’enthousiasme chevaleresque, de la sentimentalité petite-bourgeoise dans les eaux glacées du calcul égoïste. Elle a supprimé la dignité de l’individu devenu simple valeur d’échange ; aux innombrables libertés dûment garanties et si chèrement conquises, elle a substitué l’unique et impitoyable liberté de commerce. En un mot, à l’exploitation que masquaient les illusions religieuses et politiques, elle a substitué une exploitation ouverte, éhontée, directe, brutale. […]

Nous assistons aujourd’hui à un processus analogue. Les rapports bourgeois de production et d’échange, de propriété, la société bourgeoise moderne, qui a fait surgir de si puissants moyens de production et d’échange, ressemble au sorcier qui ne sait plus dominer les puissances infernales qu’il a évoquées. »

« Le sorcier qui ne sait plus dominer les puissances infernales qu’il a évoquées« . D’accord la métaphore est un peu moisie, mais avouez qu’elle trouve quand même un étrange résonance dans l’actualité … La suite je vous l’ai racontée dans ce billet 😉

La question du nombre d’écrans

Dans le brevet et la logique de Facebook, le nombre de terminaux et donc d’écrans est l’un des 6 critères déterminants permettant de « prédire » le groupe socio-économique selon le postulat suivant : « plus tu as de terminaux et d’écrans et plus tu as d’argent et donc plus je prédis que tu fais partie des riches. »

La dernière fois qu’on a fait de la science comme ça c’était pendant la période de l’inquisition et lors de la découverte de la mouche qui pète par le Professeur Thibaud, mais bon, admettons. Donc pour Facebook :

Donc ben si t’as entre 0 et 1 écran t’es « Working Class » mais pas héros, si t’en as entre 2 et 5 t’es « Middle Class », et 6 ou plus t’es « Upper Class ». Alors donc oui mais sauf que non.

Ce qui est à la fois troublant et énervant c’est que même noyée au milieu des 5 autres critères l’accompagnant, cette « analyse » et le déterminisme qui est découle est non seulement méthodologiquement inepte mais également socialement et scientifiquement … faux.

En 2016 une enquête réalisée par l’AFEV auprès de plus de 500 collégiens scolarisés en réseau d’éducation prioritaire (disponible en pdf), pointait une nouvelle forme de fracture numérique en inversion de la fracture « historique » de l’accès à l’écran :

« Plus le niveau socio-économique des foyers est bas, plus il y a d’Internet et de connexion aux écrans notamment chez les enfants et les adolescents. »

A rebours donc de l’époque où plus le taux d’équipement était élevé et plus les foyers étaient aisés, dans une époque où, en France en tout cas, le nombre d’écrans par foyer tourne autour de six, et alors même qu’un nouvel hygiénisme de la connexion s’installe dans l’opinion, les foyers les plus pauvres sont ceux qui ont le plus de mal à réguler l’accès aux écrans, ceux dans lesquels la « dérégulation » fait le plus de ravages alors que dans le même temps ce sont aussi dans ces mêmes foyers les plus pauvres que le taux d’équipement est toujours perçu comme un symbole de réussite, une forme d’accessit social à la consommation.

Bref :

« Plus le niveau socio-économique des foyers est bas, plus il y a d’Internet et de connexion aux écrans notamment chez les enfants et les adolescents. »

Dans le sillage des études sur les troubles de l’attention et de la très médiatisée « prise de conscience » d’anciens cadres des GAFAM, les Etats-Unis se trouvent exactement dans la même configuration puisque, comme le rappelle cet article du New-York Times daté du 11 février 2018, et comme le synthétisait Hubert Guillaud sur Twitter :

« la nouvelle fracture numérique n’est plus entre ceux qui n’ont pas accès aux ordinateurs et les autres, elle est entre ceux qui passent trop de temps connecté devant leurs écrans et les autres (c’est-à-dire entre les pauvres et les riches) »

Sur le « nombre d’écrans » donc, on se contentera de noter que l’approche « quantitative » (nombre d’écrans par foyer) proposée par Facebook est, pour le moins inadaptée à ce qu’il prétend être en situation de mesurer (c’est à dire l’origine sociale).

Et puis il y a le fameux « prediction module ».

Le « prediction module » : comment veux-tu,

comment veux-tu que je … te le décrive

Au coeur du brevet de Facebook se trouve le machin dénommé le « prediction module ».

C’est dans ce « prediction module » que palpite le coeur battant de l’algorithmie permettant de deviner notre classe sociale. Et voici comment il « fonctionne » :

Voilà. Donc à partir de tout un tas de données, le « prediction module » va, pour un individu donné, produire une statistique d’appartenance à l’un des trois principaux groupes sociaux : il aura par exemple 20% de chances d’appartenir à la « working class », 40% à la « middle class » et 10% à la « upper class ».

Et Facebook de nous expliquer qu’on n’arrive pas toujours à 100% car certaines données peuvent parfois être manquantes. Ben oui. Donc notre individu a quand même 40% de chances d’appartenir à la « middle class » selon le « prediction module ».

Et là, comme parfois il peut y avoir des prédictions qui se trouvent devant d’insolubles égalités, on fait appel au « Tiebreaker », au briseur d’égalité. Le Tiebreaker pour vous donner une idée, c’est un peu le Mr Wolf du brevet de détection des classes sociales.

La plupart des algorithmes « prédictifs » sont équipés de « tiebreakers » pour éviter de se trouver face à des prédictions trop égalitaires et donc aussi possiblement contradictoires que peu économiquement fécondes lorsqu’il s’agit de s’en servir pour déclencher un acte d’achat (par exemple).

Et à l’instar de Mr Wolf, le Tiebreaker n’est pas là pour faire dans la dentelle. Si le « prediction module » donne des prédictions trop serrées pour permettre de savoir avec suffisamment de certitudes si on s’adresse à un salaud de pauvre ou à un riche actionnaire bienveillant, Mr Wolf-TieBreaker débarque et pondère des trucs plus que d’autres. Par exemple toujours, et comme expliqué dans le brevet en question et dans l’extrait reproduit ci-dessus, le Tiebreaker, pour déterminer une classe sociale d’appartenance plutôt qu’une autre, va pondérer le nombre de terminaux connectés à internet que possède l’utilisateur beaucoup plus fortement que le plus haut niveau de diplôme atteint par le même utilisateur (…)

Pas très classe (sociale), ce brevet ?

Dans la tourmente que traverse Facebook depuis – au moins – ces « deux ans d’enfer« , cet énième histoire a naturellement agité la presse spécialisée et a obligé Facebook à indiquer qu’il n’allait pas nécessairement utiliser ce brevet :

« We often seek patents for technology we never implement, and patents should not be taken as an indication of future plans.«

Comme on dit sur Twitter, #OhWait …

La prédiction c’est l’opium du peuple

Il y a presque très longtemps, aux alentours de 2013, quand je commençais à réfléchir aux technologies dites de « prédiction », j’avais été frappé par une inversion et par un renversement. En très peu d’années, les principaux modèles algorithmiques disponibles pour réguler l’ensemble de nos usages et de nos comportements connectés s’étaient comme « retournés ».

Nous étions passé d’un temps où les machines (1) se servaient de nos représentations (discours, pages web) pour (2) produire des modèles (algorithmiques) et les (3) alimenter à l’aide de données, à un temps où les machines (1) se servaient désormais de données (statistiques et Big Data) pour (2) modéliser des comportements (algorithmiques) et (3) y associer des représentations choisies pour leur valeur de preuve (discours, statuts). L’expression de nos représentations n’était plus qu’un prétexte. Une pré-diction. Assertive et performative.

Dans cette inversion s’est construit progressivement une nouvelle forme d’automatisation et de sériation des inégalités qui culmine dans le brevet déposé par Facebook autour de la « prédiction » de notre classe sociale.

Dans la même conférence de 2013, je soulignais ce que j’appelais « le pacte Faustien de la prédiction » : si nous acceptons ces logiques de prédiction c’est parce qu’elles nous permettent d’économiser le coût cognitif d’une formalisation qui peut-être celle d’une recherche sur Google, d’un achat sur Amazon ou d’un rendez-vous amoureux sur un site de rencontre. Et que dans cette ‘économie » d’apparence se construit une aliénation féconde pour le marché et les algocraties qui prétendent le servir. Marx disait de la religion qu’elle était l’opium du peuple. Plus précisément il écrivait ceci :

« La religion prédiction est le soupir de la créature opprimée, l’âme d’un monde sans coeur, comme elle est l’esprit de conditions sociales d’où l’esprit est exclu. Elle est l’opium du peuple. L’abolition de la religion prédiction en tant que bonheur illusoire du peuple est l’exigence que formule son bonheur réel. Exiger qu’il renonce aux illusions sur sa situation c’est exiger qu’il renonce à une situation qui a besoin d’illusions. La critique de la religion prédiction est donc en germe la critique de cette vallée de larmes dont la religion prédiction est l’auréole. »

La prédiction est le soupir de la créature opprimée

Et voilà tout. Qu’il soit ou non finalement utilisé, l’histoire de ce brevet de détection de la classe sociale, c’est une nouvelle histoire de l’oppression d’une classe sur une autre. Une oppression qui est une automatisation qui est elle-même une essentialisation.

En fait, la conclusion de l’article que vous êtes en train de lire a déjà été écrite dans un ouvrage paru bien avant la publication du brevet des classes sociales, ouvrage de Virginia Eubanks titré « De l’automatisation des inégalités« , que je n’ai personnellement pas lu mais dont Hubert Guillaud nous livre, comme il en a l’habitude, une synthèse et une mise en perspective brillante et exhaustive.

« Eubanks souligne que ce contrôle s’exerce sur des membres de groupes sociaux plus que des individus : gens de couleurs, migrants, groupes religieux spécifiques, minorités sexuelles, pauvres et toutes populations oppressées et exploitées. Les groupes les plus marginalisés sont ceux sur lesquels le plus de données sont collectées. Et le problème, souligne Virginia Eubanks, c’est que « cette collecte de données renforce leur marginalité » en créant « une boucle de rétroaction de l’injustice » qui renforce à son tour la surveillance et le soupçon. (…)

En enquêtant sur une poignée de systèmes automatisés développés pour optimiser les programmes sociaux américains, elle dénonce une politique devenue performative … c’est-à-dire qui réalise ce qu’elle énonce. Selon elle, les programmes sociaux n’ont pas pour objectif de fonctionner, mais ont pour objectif d’accumuler de la stigmatisation sur les programmes sociaux et renforcer le discours montrant que ceux qui bénéficient de l’assistance sociale sont, au choix, des criminels, des paresseux ou des profiteurs. La rationalisation des programmes d’aide publics du fait de la crise et des coupes budgétaires les contraint à toujours plus de performance et d’efficacité. Or cette performance et cette efficacité s’incarnent dans des outils numériques qui n’ont rien de neutre, pointe la chercheuse. »

L’avenir de l’automatisation est littéralement glaçant et n’a rien d’un fantasme Orwellien puisqu’il « tourne » déjà dans un très grand nombre d’états et de services publics. Et pourtant :

« Les spécifications sociales pour l’automatisation se sont basées sur l’épuisement et l’usure des bénéficiaires, sur des postulats de classes et de races qui ont été encodées en métriques de performances. »

(…) De son observation patiente, la chercheuse dresse plusieurs constats. Partout, les plus pauvres sont la cible de nouveaux outils de gestion qui ont des conséquences concrètes sur leurs vies. Les systèmes automatisés ont tendance à les décourager de réclamer les ressources dont ils ont besoin.

Tous les systèmes caractérisent les plus démunis comme personne à risques. Tous ces systèmes rendent chacun de leur mouvement plus visible et renforcent la surveillance dont ils sont l’objet. Ils visent plus à « manager les pauvres qu’à éradiquer la pauvreté ». Enfin, ces systèmes suscitent très peu de discussion sur leurs réels impacts et leur efficacité. Or, ils font naître des « environnements aux droits faibles », où la transparence et la responsabilité politique semblent absentes. »

A chaque fois, je dis bien à chaque fois que vous entendrez parler du fantasme de la start-up nation et de l’idéologie de l’automatisation qui l’accompagne, à chaque fois que l’on vous expliquera que dans le domaine de la santé, du logement, de l’éducation ou de la justice on est en train de mettre en place des procédures algorithmiques visant à faciliter et à rendre plus juste la prise de décision dans des services publics, à chaque fois relisez attentivement les mots ci-dessus. Et n’oubliez jamais. Jamais.

« Les spécifications sociales pour l’automatisation se sont basées sur l’épuisement et l’usure des bénéficiaires, sur des postulats de classes et de races qui ont été encodées en métriques de performances. »

A lire tout cela on se souvient bien sûr de Lawrence Lessig et de son Code Is Law. De l’importance qu’il soulignait déjà en 1999 de former les ingénieurs et les développeurs à des questions juridiques, éthiques, philosophiques ; à ce qu’il racontait sur le fait que les programmes transmettaient avant tout des chaînes de valeurs, et que ces valeurs n’étaient pas uniquement des « variables » mais bien des postures et des postulats relevant de la morale. Une thèse reprise et développée par Virginia Eubanks :

« Quand on parle de technologies, on évoque toujours leurs qualités. Leurs promoteurs parlent de technologies disruptives, arguant combien elles secouent les relations de pouvoirs instituées, produisant une gouvernementalité plus transparente, plus responsable, plus efficace, et intrinsèquement plus démocratique. » Mais c’est oublier combien ces outils sont intégrés dans de vieux systèmes de pouvoirs et de privilèges. »

La métaphore de l’hospice numérique qu’elle utilise permet de résister à l’effacement du contexte historique, à la neutralité, que la technologie aimerait produire. L’hospice numérique produit les mêmes conséquences que les institutions de surveillance passées : elle limite le nombre de bénéficiaires des aides, entrave leur mobilité, sépare les familles, diminue les droits politiques, transforme les pauvres en sujets d’expérience, criminalise, construit des suspects et des classifications morales, créé une distance avec les autres classes sociales, reproduit les hiérarchies racistes et ségrégationnistes… Sa seule différence avec les institutions d’antan est de ne plus produire de l’enfermement physique. Certainement parce que l’enfermement dans les institutions de surveillance a pu produire des solidarités qui ont permis de les combattre … Les outils numériques produisent non seulement de la discrimination, mais aussi de l’isolement entre ceux qui partagent pourtant les mêmes souffrances.

(…) Les problèmes sont toujours interprétés comme relevant de la faute du demandeur, jamais de l’Etat ou du prestataire. La présomption d’infaillibilité des systèmes déplace toujours la responsabilité vers l’élément humain. Elle renforce le sentiment que ces systèmes fonctionnent et que ceux qui échouent dans ces systèmes sont ingérables ou criminels.

Ces modèles distinguent les pauvres parmi les pauvres. La classe moyenne ne tolérerait pas qu’on applique des outils de ce type sur elle. Ils sont déployés à l’encontre de ceux qui n’ont pas le choix. »

Briseurs de grève et d’égalité

Ces systèmes, en effet, sont déployés « à l’encontre de ceux qui n’ont pas le choix« . Et chacun en est aujourd’hui la victime dans la trivialité du moindre de ses comportements connectés ou en tout cas observables sous le radar d’une connectivité ambiante et d’une surveillance idoine. Les plus pauvres bien sûr, mais toute la « classe moyenne » également. « Ceux qui n’ont pas le choix » ont désormais celui de faire confiance à des « modules de prédiction » qui choisissent à leur place et qui intègrent différents « briseurs d’égalité » (tiebreaker) comme les vieux systèmes capitalistes, dès l’invention du Fordisme, nourrissaient en leur sein des briseurs de grève.

Quand les prolétaires de tous les pays se seront unis et que ce seront eux qui programmeront les algorithmes, alors peut-être, viendra le jour de la lutte algorithmique finale. Pour l’instant les algorithmes sont copieusement nourris aux valeurs d’un groupe socio-économique qui, lui, est parfaitement à l’aise avec sa conscience de classe, et qui voit dans la promesse du déterminisme calculatoire l’occasion d’installer encore davantage sa domination sur tous les autres. La première de ces valeurs étant d’effacer toute conscience de classe des « dominés » en la reléguant dans les limbes d’un « module prédictif ».

Ce qui fut longtemps rejeté comme un simple postulat idéologique, cette idée d’une lutte des classes qui se jouerait à l’échelle algorithmique des grandes plateformes, est désormais scientifiquement démontré et documenté, dans les travaux et ouvrages d’Antonio Casilli, de Virginia Eubanks, de Zeynep Tufekci, de Cathy O’Neil et de tant et tant d’autres. Il n’est donc pas impossible que nous finissions par nous réveiller collectivement. Il n’est pas non plus exclu qu’il soit un peu trop tard pour le faire ou qu’en tout cas les dégâts de notre réveil tardif soient considérables.

Source : Affordance typepad